OpenAI amenazada por entidad de regulación en EE. UU.

OpenAI desarrolla lo que se conoce como «grandes modelos de lenguaje». Estos algoritmos utilizan enormes cantidades de datos de texto para aprender patrones en el lenguaje humano y poder así generar respuestas coherentes y humanizadas. ChatGPT, un ejemplo prominente, ha estado en el centro de la atención pública desde su lanzamiento.

Un panorama competitivo

Con la popularidad de ChatGPT, se ha desencadenado una carrera entre gigantes de la tecnología como Google y Meta, quienes han lanzado sus propios modelos de lenguaje. Sin embargo, esta competencia también ha levantado preocupaciones acerca de la veracidad de la información generada por estos modelos y cómo se utilizan.

Polémica en torno a la precisión de los datos

Existen casos documentados de uso indebido y desinformación vinculados a estos modelos de IA. Por ejemplo, un abogado enfrentó sanciones por usar ChatGPT para crear casos falsos, y un presentador de radio demandó a OpenAI por falsas acusaciones de malversación. Este tipo de incidentes han probablemente influido en la decisión de la FTC de investigar.

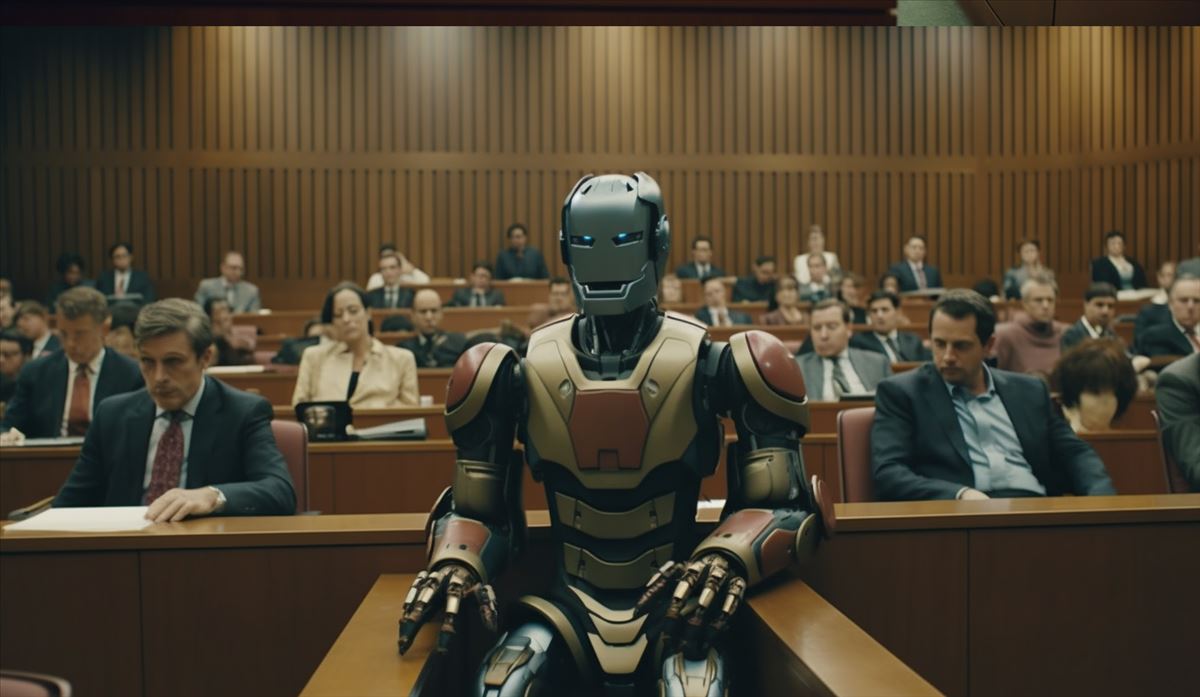

Regulación de la IA

Ante el rápido crecimiento e influencia de la IA, los cuerpos reguladores y los legisladores están buscando comprender y establecer marcos legales alrededor del uso de esta tecnología. La administración de Biden ha revelado planes para desarrollar un marco responsable para el desarrollo de IA, mientras que líderes de la industria como Sam Altman, CEO de OpenAI, han defendido la necesidad de regulaciones.

Esta investigación puede marcar un hito en la búsqueda de un equilibrio entre los avances tecnológicos y la necesidad de prácticas éticas y responsables en la IA. Los desafíos y responsabilidades asociados con la gestión de herramientas de IA potentes como ChatGPT son evidentes, y este caso pone de manifiesto la importancia de la regulación para garantizar su uso beneficioso y minimizar los posibles riesgos.

Las demandas a OpenAI por parte de la Comisión Federal de Comercio (FTC) de Estados Unidos son el primer indicio de cómo pretende hacer cumplir esas advertencias. Si la FTC descubre que una empresa infringe las leyes de protección del consumidor, puede imponer multas o someter a una empresa a un decreto de consentimiento, que puede determinar la forma en que la empresa maneja los datos. La FTC se ha convertido en el principal policía del gobierno federal en Silicon Valley, imponiendo cuantiosas multas a grandes empresas, como Meta, Amazon y Twitter por supuestas infracciones de las leyes de protección del consumidor.

La FTC le exigió a OpenAI que proporcionara descripciones detalladas de todas las quejas que había recibido sobre sus productos que hacían afirmaciones "falsas, engañosas, despectivas o perjudiciales" sobre las personas. Según el documento, la FTC está investigando si la empresa incurrió en prácticas desleales o engañosas que causaron un "daño a la reputación" de los consumidores.

La FTC también exigió los registros referentes a un incidente de seguridad que la empresa reveló en marzo, cuando un fallo en sus sistemas permitió a algunos usuarios ver información relacionada con pagos, así como algunos datos del historial de chat de otros usuarios. El organismo federal está investigando si las prácticas de seguridad de datos de la empresa violan las leyes de protección del consumidor. OpenAI dijo en una entrada de blog que el número de usuarios cuyos datos fueron revelados a otra persona era "extremadamente bajo".